1、劳动节手抄报的图片,可以设计得有创意一些,例如下方画两双手,并打上格子,把内容写在手里面,上面画上云彩,云彩上面写上手抄报的大题目,缤纷五一。

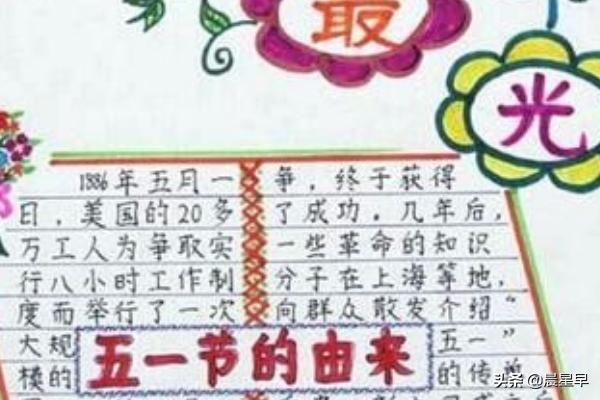

2、大题目劳动最光荣这几个字用花环围起来,下方的图画,左边画一个小男孩,右边画一个小女孩,他俩都在劳动。

3、手抄报还可以画成诗配画的形式,例如《锄禾》这首诗,可以画上老农在田里劳作的情景。

4、右上角和左下角都可以画上花朵,中间再画两个大花朵的形状,把内容写在大花朵里面。

5、画上两朵美丽的色彩繁多的太阳花,左下角画上小风车的图案。

6、中间画上蜜蜂浇向日葵的图案,左上角画上大太阳。

7、可以画非常简单的图画,例如画上小房子,小蜜蜂,勤劳的蜜蜂就象征着热爱劳动的我们。